MIT’nin Yeni Yazılımı: PhotoGuard

Yapay Zeka Haberleri

Massachusetts Teknoloji Enstitüsü Bilgisayar Bilimi ve Yapay Zekâ Laboratuvarı’ndaki (MIT CSAIL) araştırmacılar, görüntüleri kötü niyetli AI düzenlemelerine karşı koruyabilen son derece gelişmiş ve etkileyici bir yazılım olan “PhotoGuard”ı duyurdu.

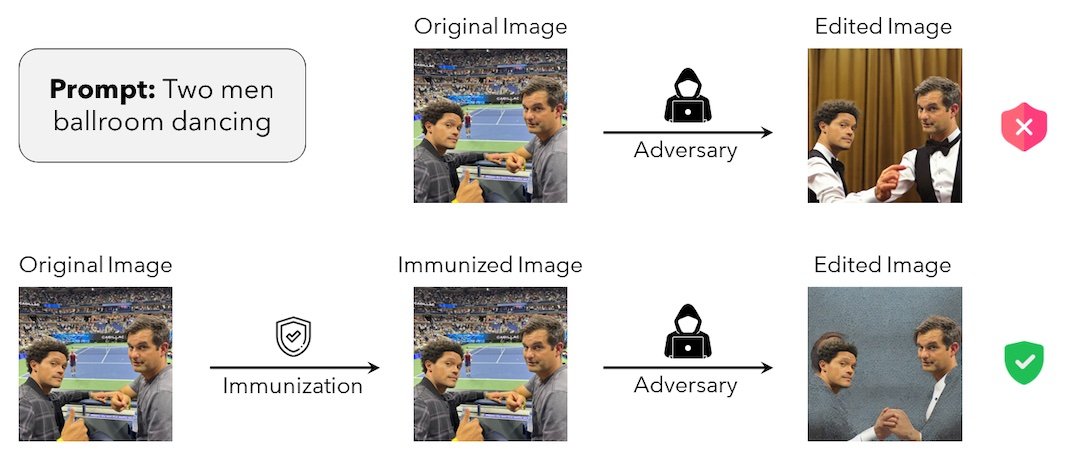

Filigran teknikleri, çalıntı risklerini hafifletmeye yardımcı olabiliyorken, MIT CSAIL tarafından geliştirilen yeni teknik, izinsiz değiştirmeleri önlemeye yardımcı oluyor. GitHub’da bulunan bu program, bir görüntüdeki seçili pikselleri, yapay zekanın görüntünün ne olduğunu anlama yeteneğini bozacak şekilde değiştirerek çalışıyor. Araştırma ekibinin deyimiyle bu “pertürbasyonlar” insan gözüyle görülemez ancak makineler tarafından kolayca okunabilir. Bu “kodlayıcı” saldırı yöntemi, algoritmik modelin hedef görüntünün gizli temsilini (bir görüntüdeki her pikselin konumunu ve rengini tanımlayan karmaşık matematik) hedef alıyor ve esasen yapay zekanın neye baktığını anlamasını engelliyor.

Daha gelişmiş ve hesaplama açısından yoğun olan “difüzyon” saldırı yöntemi ise, bir görüntüyü yapay zekanın gözünde farklı bir görüntü olarak kamufle ediyor. Bu yöntem, bir hedef görüntüyü tanımlıyor ve hedefine benzeyecek şekilde görüntüdeki düzensizlikleri optimize ediyor. Bir yapay zekanın bu dayanıklı görüntüler üzerinde yapmaya çalıştığı herhangi bir düzenleme, sahte “hedef” görüntülere uygulanarak gerçekçi olmayan bir görüntü oluşmasına neden oluyor.

Örnek olarak ekip, bir tenis maçı sırasında Trevor Noah ve Michael Kosta’nın Instagram gönderisinde PhotoGuard’ı kullandı. Sistem yerinde değilse resmi değiştirmek ve iki balo salonunu dans ettirmek için yapay zeka kullanmanın ne kadar basit olduğunu gösterdiler. Ancak PhotoGuard’ın yardımıyla yapay zekanın resmi değiştirmesini başarıyla engelledi.

![]()

Öte yandan yaratıcılığına rağmen, PhotoGuard’ın yüzde 100 koruma sağladığını söylemek ne yazık ki henüz mümkün değil. Zira günün sonunda görüntüyü manipüle etmek isteyenler görsele dijital gürültü ekleyebilir ya da ters çevirerek korunan görüntüleri çözmeye çalışabilirler.

MIT doktora öğrencisi ve çalışmanın baş yazarı Hadi Salman, bu teknolojiyi Apple ve Google’ın sırasıyla iPhone ve Android‘deki stok kamera uygulamalarına eklemeyi düşünmesi gerektiğini söylerken, “Model geliştiricileri, sosyal medya platformları ve politika yapıcıları içeren işbirlikçi bir yaklaşım, yetkisiz görüntü manipülasyonuna karşı güçlü bir savunma sunuyor. Bu acil konu üzerinde çalışmak bugün büyük önem taşıyor. Bu çözüme katkıda bulunmaktan memnuniyet duysam da, bu korumayı pratik hale getirmek için daha fazla çalışma gerekiyor. Bu modelleri geliştiren şirketlerin, bu yapay zeka araçlarının yol açtığı olası tehditlere karşı sağlam önlemler tasarlamaya yatırım yapması gerekiyor.”dedi.

Dolayısıyla bu sorunun üstesinden tamamen gelebilmek için model geliştiricilerin, sosyal medya platformları ve politika yapıcılarla birlikte yetkisiz görüntü manipülasyonuna karşı güçlü savunmalar oluşturmak için iş birliği yapması gerekiyor. Nitekim Hadi Salman da, bu korumayı daha etkili hale getirmek için devam eden çabaların gerekliliğini vurguluyor.

- KATEGORİLER:

- | Yapay Zeka Haberleri |